Introducción

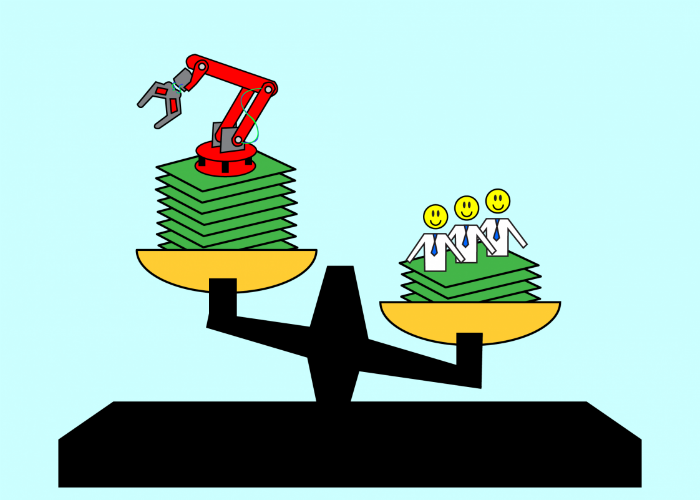

Hace tiempo que hay un debate muy interesante sobre la mesa . El debate es, ¿reemplazará la IA a los humanos en el trabajo? Y en caso de que esto sucediese, ¿sería capaz el humano de reciclarse y adaptarse a un nuevo mundo laboral?

Debida a la irrupción de robots, automatización y el desarrollo de la inteligencia artificial (IA), el mundo laboral ya ha comenzado a cambiar sectores como son la industria o la automoción. Según un estudio de PwC, en España este cambio no será significativo hasta la década de 2030, pero una vez dado este cambio se dice que 1 de cada 3 trabajos pasarán a ser hechos por una máquina.

La OCDE afirma en un informe de 2017 que un 11,7 de los puestos de trabajo en España tienen alta probabilidad de ser automatizados durante las próximas décadas.

Ludismo

Que la sociedad tenga miedo de que haya máquinas que les puedan quitar el trabajo no es algo nuevo. Ya allá a principio del siglo XIX hubo un movimiento conocido como «ludismo». Este movimiento fue propulsado por artesanos ingleses que veían como podían perder sus trabajo debido a la industrialización. La respuesta de estos fue quemar fábricas, talleres… A pesar de ello no fueron capaces de frenar un movimiento imparable como la industrialización.

Oportunidades y amenazas

Está claro que la automatización de gran parte del mundo laboral traería un cambio muy grande a nuestras vidas, pero veamos cuáles son las oportunidades y cuáles las amenazas.

Está claro que hay ciertos perfiles que se verán más beneficiados que otros. En este caso vemos como los trabajos relacionados con la ciencia, la tecnología, la ingeniería y las matemáticas son los que tendrán un mayor protagonismo. Aunque quizá la mayor oportunidad que nos brinda este panorama es la de eliminar trabajos de poco valor añadido. Esto se debe a que la IA podrá realizar este tipo de tareas y así nosotros podremos estar más enfocados en tareas más cualificadas.

Actualmente hay muchas preguntas acerca de la IA. ¿Qué puede hacerse con la IA? o ¿Cómo puede aplicarse la IA de forma ética?, la cosa es mucho más compleja, y aquí entra una de las amenazas. En el momento en que las decisiones en el espacio laboral empiezan a basarse en criterios no controlados por un humano, surgen una serie de adversidades que han de incluirse en cualquier debate sobre la «ética» en la aplicación y el uso de la IA. En este artículo existe más información acerca de la ética en el uso de la IA.

¿Nos adaptaremos a este nuevo panorama?

Es quizá el tema central de esto, porque damos por hecho que esta automatización se dará, ¿pero que va a pasar con nosotros? ¿Qué perfiles serán los más demandados?

La capacidad de aprendizaje va a ser clave en los próximos años, estar constantemente estudiando, informado de nuevas tendencias… El profesional del futuro será alguien que esté en constante adaptación al proyecto en el que esté desarrollando su función. Es por ello que la capacidad de aprendizaje va a ser lo que salve a las personas de no verse excluidas del mundo laboral. Hay habilidades como la creatividad y la inteligencia emocional que permitirán explotar el potencial humano y permitirán a las personas mejorar a los robots en vez de ser sustituidos por ellos.

Perfiles más demandados

¿Y cuáles serán los perfiles más demandados del futuro y los que lo tendrán más difícil? Apunta a que los trabajos más afectados serán aquellos que requieran una menor formación, así como aquellos relacionados con las ventas, la administración y tareas de oficinas… Por el contrario habrá un incremento en la demanda de profesionales que sean capaces de de liderar proyectos, equipos… Así como aquellos que tengan una gran creatividad y pensamiento crítico, que al fin y al cabo son cualidades en las que los humanos siempre seremos superiores a las máquinas (a priori). Además, según un estudio realizado por ManpowerGroup, 8.000 directivos de 43 países creen que a corto y medio plazo habrá un aumento de empleos relacionados con el sector de tecnología de la información, así como expertos en robótica y relacionados.

Conclusión

Una vez sabemos que la IA se incorporará tarde o temprano al mundo laboral, es necesario preguntarse, ¿ realmente la IA es estrictamente necesaria para el futuro del mundo laboral?, ¿nos llevará a un escenario mucho más fructífero como se proclama, o será un retroceso?

Aunque las máquinas a día de hoy tienen una capacidad de procesamiento y aprendizaje muy alta, estas carecen de bagaje histórico, de contexto. Al fin y al cabo trabajan con los datos que un humano les proporciona, por lo que pueden caer en los mismos errores que nosotros. Es por ello que debemos pensar, ¿en qué posición de poder debemos colocar a la máquinas dentro del mundo laboral? Si algo está claro, es que la inteligencia humana debe prevalecer, mientras que la máquina se convierte en un complemento más que útil.

Las máquinas pueden llegar a humanizar incluso más nuestro trabajo, ¿y porque decimos esto? porque al final el propósito de la IA es eliminar trabajos repetitivos y con un valor añadido muy bajo. Puede entenderse como una oportunidad para aumentar el valor de los empleados, para eliminar esos trabajos poco agradecidos e incrementar la creatividad, el análisis, la toma de decisiones… En definitiva, devolverle el sentido al trabajo, que en estos tiempos que corren es algo esencial para generaciones venideras.

WRITTEN BY

Alejandro Ferrer

Saturdays.AI

Saturdays.AI is an impact-focused organization on a mission to empower diverse individuals to learn Artificial Intelligence in a collaborative and project-based way, beyond the conventional path of traditional education