Introducción

La inteligencia artificial entra en guerra. Este es el titular que se nos viene a la cabeza al ver las novedades que nos llegan de la guerra entre Rusia y Ucrania. Son innumerables los campos en los que la inteligencia artificial empieza a ser esencial, y el ámbito militar no iba a ser menos. Ya en 2017 el presidente ruso, Vladimir Putin afirmaba: «Quién sea líder de la inteligencia artificial, dominará el mundo». Y no se equivocaba, países como EEUU, Rusia, China o Inglaterra están llevando a cabo grandes esfuerzos para reforzarse en este campo ya que realmente puede ser decisivo en el futuro. Tendremos campañas de desinformación en redes sociales, creación de bots, análisis de datos, identificación de objetos y personas… La guerra del futuro ya está aquí.

La guerra del futuro

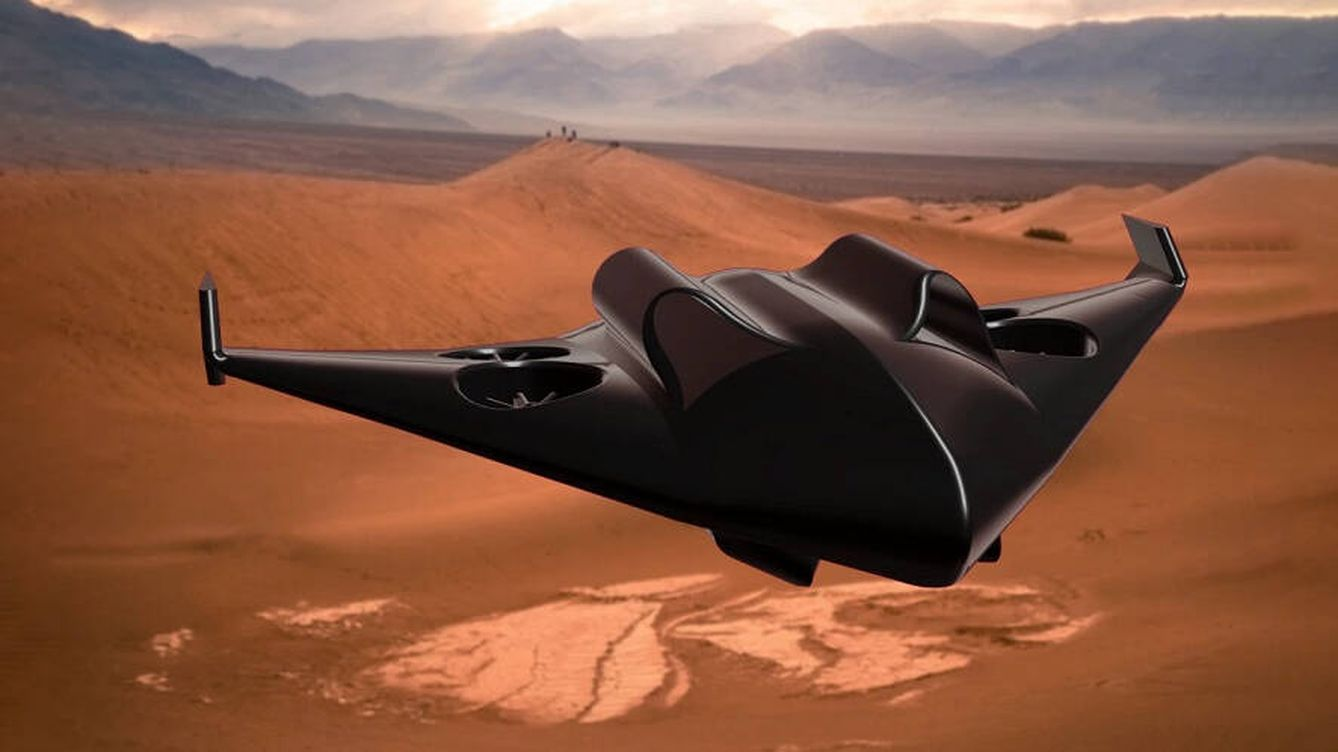

En Ucrania estamos viendo cómo se están poniendo a prueba actividades que serán claves en la guerra del futuro. EEUU está utilizando esta guerra como un campo de prueba. Estas herramientas hoy en día están procesando innumerables datos del ejército ruso. Esto servirá para poder predecir futuros pasos en la estrategia de Rusia. Según Maynard Holiday, director de investigación de defensa e ingeniería para la modernización del Departamento de Defensa de los Estados Unidos, las herramientas desarrolladas por el país norteamericano serán capaces en el futuro de cambiar el transcurso de cualquier conflicto bélico. Conflictos en los que las decisiones tomadas por humanos pasarán a un segundo plano, para dejar paso a softwares cuyas decisiones, a priori, serán más eficientes.

Aplicaciones

Es bien sabido que la inteligencia artificial puede tomar decisiones mucho más eficientes y rápidas que los humanos, es por ello que se han empezado a utilizar distintas herramientas:

OSINT, el gran hermano

Lo llamaremos el gran hermano porque es el ojo que todo lo ve. OSINT, acrónimo de Open Source Intelligence, es una herramienta que tiene como misión hacer uso de fuentes de carácter público para poder buscar y recopilar toda la información. Esto, en un contexto de guerra se traduce en analizar todas aquellas fuentes de información que conocemos para generar estrategias de ataque, infiltración, defensa… Las fuentes de información son: medios de comunicación, redes sociales tales como twitter, facebook, instagram…

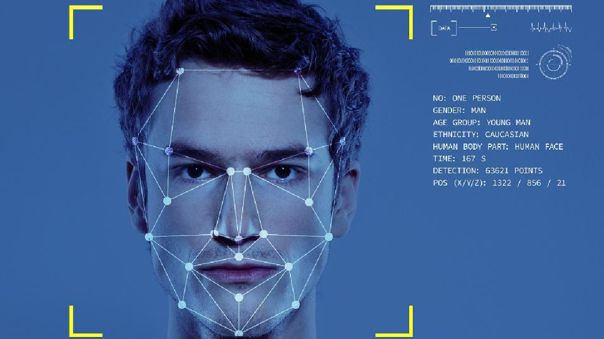

Clearview AI, el reconocedor facial

Ucrania ha empezado a utilizar este reconocedor facial con el objetivo de facilitar la tarea de identificar a enemigos rusos. La empresa americana, clearview, dispone de millones de imágenes obtenidas de VKontakte, la red social ruso similar a Facebook. Se dice que todas estas imágenes están siendo utilizadas por el ejército ucraniano para detectar enemigos.

¿En qué podría fallar?

Estaremos de acuerdo en que utilizar inteligencia artificial en un ámbito como la guerra, en el que cada decisión cuenta, de primeras debería parecer un gran avance. Pero también es verdad que sus algoritmos podrían ser increíblemente fáciles de engañar para que vean cosas que no existen y viceversa. Entonces, cualquier persona que aprendiese a confundir los sistemas de sus rivales obtendría una gran ventaja respecto a los demás. Un ejemplo claro de uno de los talones de Aquiles que podría tener la IA lo tenemos en un experimento realizado por investigadores del MIT. En este experimento conseguían que la IA de Google confundiese una tortuga con un rifle. Consiguieron esto gracias a la modificación del objeto en versión 3D, y aunque a simple vista (humana) es fácilmente reconocible, la IA daba con un 90% de fiabilidad que no se trataba de una tortuga sino de un rifle.

Aquí es donde encontramos un talón de Aquiles claro, los investigadores del MIT desarrollaron un algoritmo capaz de engañar de manera fiable a un modelo de aprendizaje automático. Es decir, se podría engañar a los enemigos camuflando los tanques, aviones, militares etc.… para que no fuesen reconocidos por sus sistemas.

Ética

El gobierno de los EEUU contaba con un proyecto cuyo objetivo era automatizar la identificación de objetos aéreos en imágenes. Para dicho proyecto estaba contratada la empresa americana «Google». La compañía abandonó el proyecto a causa de las protestas de sus trabajadores. Después de estas protestas internas en la multinacional, crearon un nuevo código ético para el uso de la IA. En él nos dicen que no usarán sus algoritmos para desarrollar armas, u otras tecnologías cuyo objetivo principal o implementación sea causar o facilitar directamente lesiones a la gente. Es por ello que se abre un debate, ¿debemos utilizar la inteligencia artificial para producir daño?, ¿realmente queremos que la inteligencia artificial entre en guerra?

Bibliografía

Altim (Abril 2022) https://www.altim.es/blog-noticias-tic/la-inteligencia-artificial-un-arma-mas-en-la-guerra-de-ucrania/

MIT (Octubre 2019) https://www.technologyreview.es/s/11563/la-paradoja-de-la-ia-militar-un-arma-peligrosa-que-nadie-debe-obviar

MIT (Junio 2018) https://www.technologyreview.es/s/10297/los-siete-principios-de-google-para-evitar-criticas-sus-proyectos-militares

Antena 3 (Noviembre 2017) https://www.antena3.com/noticias/tecnologia/google-confunde-tortuga-rifle_2017110559fee7490cf2ebaa1659924d.html

El Confidencial (Abril 2022) https://www.elconfidencial.com/tecnologia/novaceno/2022-04-25/pentagono-rusia-ucrania-inteligencia-artificial_3413944/

Nationalinterest (Marzo 2022) https://nationalinterest.org/blog/techland-when-great-power-competition-meets-digital-world/artificial-intelligence-and-future

Written by

Alejandro Ferrer

¡Más inteligencia artificial!

La misión de Saturdays.ai es hacer la inteligencia artificial más accesible (#ai4all) mediante cursos y programas intensivos donde se realizan proyectos para el bien (#ai4good).

Infórmate de nuestro master de inteligencia artificial en https://saturdays.ai/master-ia-online/

Si quieres aprender más inteligencia artificial únete a nuestra comunidad en community.saturdays.ai o visítanos en nuestra web www.saturdays.ai ¡te esperamos!